en temps réel

des calculs physiques

d'environnement

La nouvelle version de Virtual Crash 6 sera disponible à partir de mai 2024.

LOGICIEL DE RECONSTRUCTION D’ACCIDENT

Nouvelle version disponible à partir de mai 2024

LIGHTSPEED moteur de rendu en temps réel, Diagrammes, Animations de véhicules, Animations humaines, Simulations, Momentum, Nouveaux modèles humains, plus de 100 nouveaux véhicules, Eclairage volumétrique, Intégration des nuages de points et de la photogrammétrie, Matériaux de rendu basés sur la physique (PBR), Googles Maps, 64-bit, et plus encore !

LE CRASH VIRTUEL RÉINVENTÉ

Virtual CRASH 6 est une application 64 bits conçue pour la reconstruction d’accidents, désormais améliorée avec un rendu en temps réel. Il comprend toutes les fonctionnalités que vous attendez de la plateforme Virtual CRASH.

Virtual CRASH 6 ! En savoir plus>

Virtual CRASH 6 ! Télécharger la version d’essai >

Journée crash-tests à TOULOUSE Jeudi 12 octobre 2023

Le programme de la journée était le suivant :

- Le matin, premier crash, voiture contre trottinette,

- L’après-midi, deuxième crash, voiture contre voiture à vitesse élevée, le passager avant droit avec les pieds sur le tableau de bord,

Retour en images sur les deux crash tests réalisés par VCRASH FRANCE

Actualités

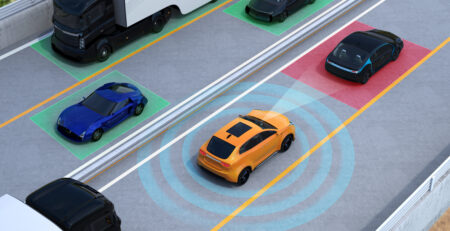

Découvrez toutes les dernières actualités de l’automobile : en matière d’accidentologie, de sécurité routière, des ADAS (aides à la conduite automobile) et des véhicules autonomes.

Soyez informé sans avoir à chercher.

Démos-vidéos

Regardez les vidéos de modélisations 3D d’accidents réalisées avec le logiciel Virtual Crash. Voitures, ensembles routiers, motos, infrastructures, humains, textures, tout est prévu dans ce logiciel.

Contact

Prenez contact à l’aide du formulaire avec les professionnels de l’expertise automobile spécialisés en accidentologie et reconstruction d’accident.

Virtual Crash France

Les gestionnaires et les webmasters sont des professionnels de l’expertise en automobile spécialisés en accidentologie et reconstruction d’accident. Ils sont l’interface entre les concepteurs du logiciel et la communauté. Ils assurent les informations et les formations sur le logiciel. Les membres de la communauté seront informés des mises à jour et publications. Les adhérents par leurs besoins et idées proposent aux concepteurs du logiciel des améliorations et évolutions.

A votre disposition pour tout renseignement, vcrashment votre.

A bientôt.